想自己打造ChatGPT吗?这个开源项目手把手教你从零构建大型语言模型!

你是否好奇ChatGPT背后的技术原理?想了解如何从零开始构建自己的大型语言模型?今天介绍的这个GitHub项目将带你一步步实现这个目标!

项目简介

LLMs-from-scratch是一个使用PyTorch从零开始实现类ChatGPT大型语言模型的完整教程。该项目由Sebastian Raschka创建,已经获得65.7k stars和9.2k forks,深受开发者欢迎。

核心功能

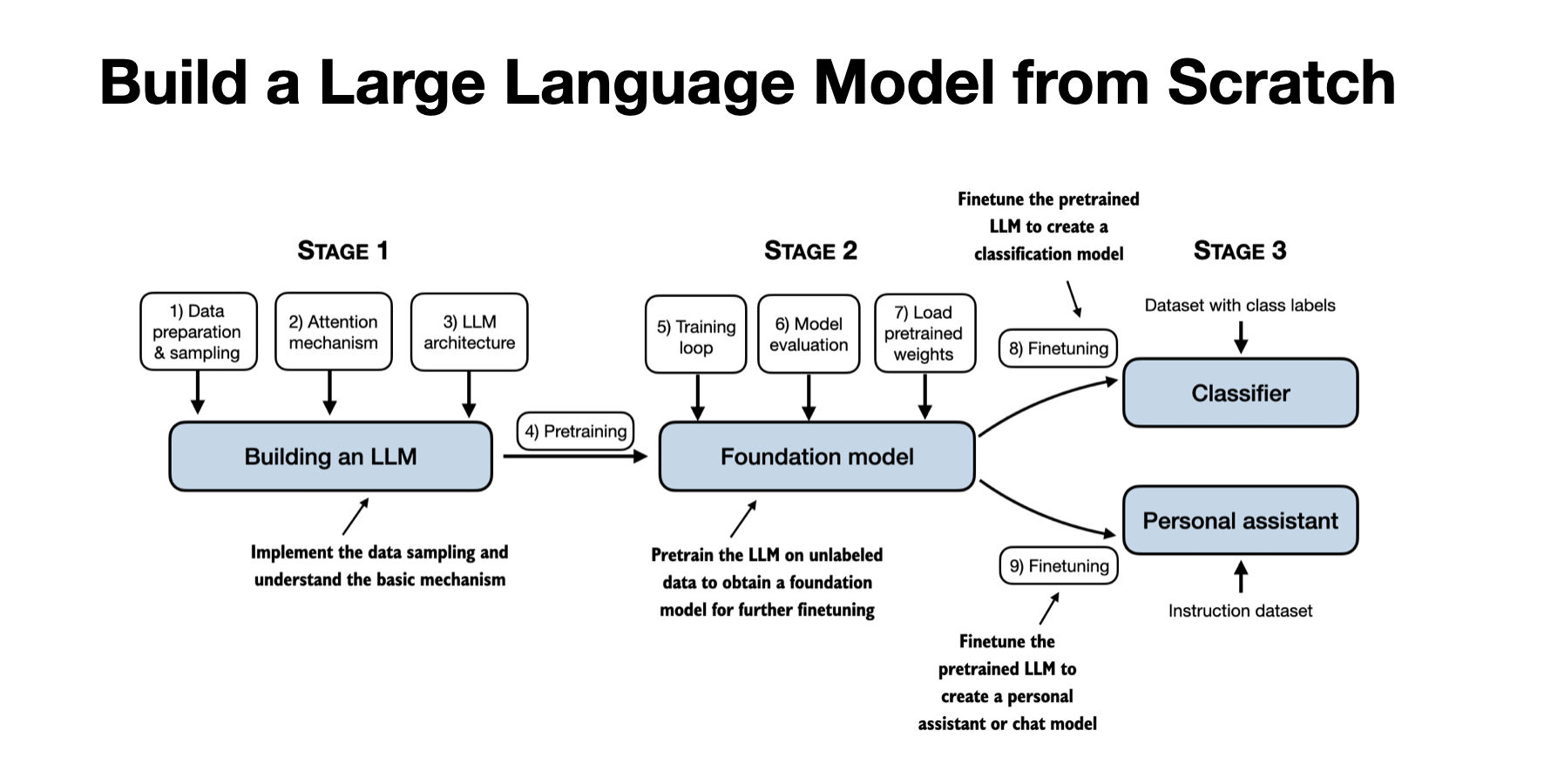

该项目提供了完整的LLM构建流程:

- 文本数据处理与分词器实现

- 自注意力机制编码

- GPT模型架构实现

- 无标注数据预训练

- 文本分类任务微调

- 指令跟随能力训练

应用场景

- 教育学习:适合机器学习爱好者和学生深入了解LLM工作原理

- 技术研究:研究人员可以基于此代码进行模型改进实验

- 自定义模型开发:开发者可以构建特定领域的语言模型

使用方法

项目采用模块化设计,按章节组织代码:

git clone --depth 1 https://github.com/rasbt/LLMs-from-scratch.git

每个章节包含主要代码和练习解决方案,从文本处理开始,逐步深入到模型训练和微调。

特色亮点

- 无需高端硬件:代码设计为可在普通笔记本电脑上运行

- 完整学习路径:包含170页的练习测试和17小时视频课程

- 实战导向:提供真实数据集上的训练和评估代码

- 扩展性强:包含LoRA参数高效微调等高级技术

同类项目对比

与Hugging Face的Transformers库不同,该项目专注于教学目的,强调从底层实现理解每个组件。而像OpenAI的API则提供现成的模型服务,不适合学习内部机制。该项目填补了理论学习与实践操作之间的空白,是入门LLM开发的绝佳选择。

无论你是AI初学者还是有经验的开发者,这个项目都能帮助你深入理解大型语言模型的核心技术,值得收藏学习!

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

暂无评论内容